-

光场 (Lytro) 和立体声 (Project Tango) 数据集

Lytro首席执行官贾森·罗森塔尔(Jason Rosenthal)谈到了“Lytro现实体验”,沉浸式体验存储为光场,然后传输到具体的每个消费终端,让VR头显到智能手机都能查看360度视频。

光场可以从捕获或渲染的体积内的任何点重新创建视图。简言之,这意味着Lytro可以作为超过实时渲染的图形能力的场景来播放,同时仍然保持身临其境的6DOF位置跟踪和(在一定程度上)交互性。Lytro的目的是结合最好的实时沉浸与预渲染的VR体验的视觉质量。

光场应用

光场数据蕴含多维度的视觉信息,主要应用可以说是解耦合多维信息,使得计算机能够更智能的感知外界,极大地提升了传统计算机视觉问题的性能。其主要应用如下:

数字重聚焦

场景深度重建(见第二部分,针对相关文献、代码都有讲解)

三维场景重建(见第三部分,深度重建与三维重建的区别?

Project Tango 的核心能力是什么?

2011 年 8 月,Google 以 125 亿美元收购了摩托罗拉。不到三年,Google 就于 2014 年 1 月将摩托罗拉卖给了联想。

不过,「精明」的 Google 留了好几手:摩托罗拉的海量专利继续充当 Android 阵营的定海神针,而神秘的 ATAP(Advanced Technology and Products, 先进技术与产品部门),也继续为 Google 研发更多前沿的技术,比如 Project Tango 和 Project Ara。

Project Tango 主要有三个核心能力:

运动追踪(Motion Tracking)

区域学习(Area Learning)

深度感知(Depth Perception)

Lytro Illum

收集了 640 个在大小、纹理、背景杂波和照明等方面具有显着变化的光场。我们生成微透镜图像阵列和中心观察图像,并生成相应的地面实况图。数据来自 Lytro Illum,捕获为 40MP 图像,然后转换为 5MP RGB+D 图像。提供了几个测试图像所需的所有数据。第二个数据集来自 Lenovo Phab2(Project Tango),它利用双图像传感器重新创建大型 3D 结构的点云。这些以 .ply 和 .obj 数据集的形式提供。

-

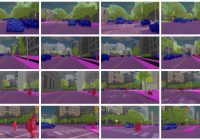

DriveSeg场景分割数据集

共享我们提供了 MIT DriveSeg 数据集,这是一个大规模的驾驶场景分割数据集,为 5,000 个视频帧中的每个像素和每个像素都进行了密集注释。这个数据集是一个面向前的逐帧像素级语义标记数据集,该数据集是在连续白天驾驶通过拥挤的城市街道时从移动的车辆捕获的。该数据集的目的是允许探索时间动态信息的价值,以便在动态的真实操作环境中进行全场景分割。

-

水质断面经纬度地表水环境部监测

水质断面经纬度地表水环境部监测“十四五”融合地表水国控断面监测站点经纬度信息_3647点位

¥ 400.00 起“十四五”地表水水质国控断面坐标位置数据,共3647点位,含所属省份,所属地区,责任省份,所属流域,所属河流(湖库),站点代码,断面代码,断面名称,经度,纬度,汇入水体,断面类型,断面属性等信息

-

综合汽车数据集

共享该数据集是被CVPR 2015 论文“用于细粒度分类和验证的大规模汽车数据集”所使用的。综合汽车 (CompCars) 数据集包含来自两个场景的数据,包括来自网络自然和监视自然的图像。 web-nature 数据包含 163 个汽车制造商和 1,716 个汽车型号。 总共有 136,726 张拍摄整车的图像和 27,618 张拍摄汽车零件的图像。 完整的汽车图像标有边界框和视点。 每个车型都标有五

-

RESIDE

共享数据集介绍: RESIDE数据集包括合成和真实世界的模糊图像,称为REalistic Single Image Dehazing,RESIDE突出显示了各种数据源和图像内容,并分为五个子集,每个子集用于不同的训练或评估目的。提供了各种各样的去雾算法评估标准,从完整参考度量,无参考度量,到主观评估和任务驱动评估。 引用: @article{li2019benchmarking, title={B