DriveSeg场景分割数据集

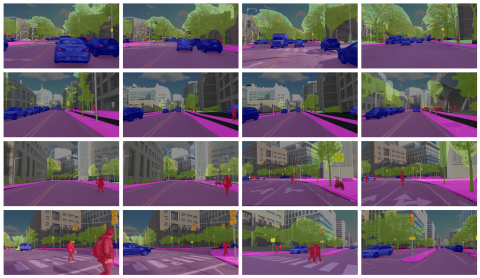

我们提供了 MIT DriveSeg 数据集,这是一个大规模的驾驶场景分割数据集,为 5,000 个视频帧中的每个像素和每个像素都进行了密集注释。这个数据集是一个面向前的逐帧像素级语义标记数据集,该数据集是在连续白天驾驶通过拥挤的城市街道时从移动的车辆捕获的。该数据集的目的是允许探索时间动态信息的价值,以便在动态的真实操作环境中进行全场景分割。

-

DriveSeg场景分割数据集简介

我们提供了 MIT DriveSeg 数据集,这是一个大规模的驾驶场景分割数据集,为 5,000 个视频帧中的每个像素和每个像素都进行了密集注释。这个数据集是一个面向前的逐帧像素级语义标记数据集,该数据集是在连续白天驾驶通过拥挤的城市街道时从移动的车辆捕获的。该数据集的目的是允许探索时间动态信息的价值,以便在动态的真实操作环境中进行全场景分割。

麻省理工学院和丰田发布DriveSeg数据集以加速自动驾驶研究,DriveSeg包含许多常见道路对象的精确像素级表示,并通过连续视频驾驶场景的镜头。我们如何训练自动驾驶模型,以加深对周围世界的认识?计算机能否从过去的经验中学习以识别未来的模式,以帮助他们安全地应对新的不可预测的情况?麻省理工学院运输与物流中心的AgeLab和丰田合作安全研究中心(CSRC)的研究人员发布了DriveSeg的开放数据集。通过发布DriveSeg,麻省理工学院和丰田汽车正在努力推进自动驾驶系统的研究,就像人类的感知一样,自动驾驶系统将驾驶环境视为连续的视觉信息流。

迄今为止,提供给研究团体的自动驾驶数据主要由大量静态的单一图像组成,这些图像可用于识别和跟踪在道路内和道路周围发现的常见物体,例如自行车,行人或交通信号灯,通过使用“边界框”。相比之下,DriveSeg包含许多相同的常见道路对象的更精确的像素级表示,但是是通过连续视频驾驶场景的镜头。

这种类型的全场景分割对于识别更多不总是具有这种定义和统一形状的无定形对象(例如道路建设和植被)尤其有用。根据Sherony的说法,基于视频的驾驶场景感知提供的数据流更类似于动态,现实世界的驾驶情况。它还使研究人员能够随着时间的推移探索数据模式,这可能推动机器学习,场景理解和行为预测方面的进步。

非结构化数据成增长主力的当下和未来,格物钛数据平台帮助机器学习团队更好地释放非结构化数据潜力,让AI应用开发更快、性能表现更优。

【导读】麻省理工学院和丰田发布DriveSeg数据集以加速自动驾驶研究,DriveSeg包含许多常见道路对象的精确像素级表示,并通过连续视频驾驶场景的镜头。

自动驾驶的公开数据集主要由视频和图片组成,近两年也增加了许多雷达数据。并且,好几个知名的大型数据项目都开放了众包的形式,自动驾驶方面的数据量会越来越大,其种类也会愈发丰富(仅统计目前2020年前半段多个…

目前,数据集的数据来源主要包括 相机(图片),摄像头(视频序列),激光雷达(点云),毫米波雷达,4D 成像毫米波雷达,IMU, GPS等,而相对应的任务主要包括:点云分割,目标检测与追踪等。下面将自动驾驶相关的…

MIT DriveSeg Dataset for Dynamic Driving Scene Segmentation

数据由两部分(manual与semi-auto)组成。DriveSeg(manual)是在马萨诸塞州剑桥市繁忙的街道上白天捕获的2分47秒的高分辨率视频。该视频的5,000帧使用12类道路对象的每像素人工标签进行密集注释。

DriveSeg(semi-auto)是从MIT高级车辆技术(AVT)联盟数据中提取的20,100个视频帧(67个10秒的视频剪辑)。DriveSeg(Semi-auto)与DriveSeg(manual)具有相同的像素级语义注释,除了注释是通过MIT开发的新型半自动注释方法完成的。与手动注释相比,此方法利用了手动和计算的努力,可以以较低的成本更有效地粗略地注释数据。创建该数据集的目的是评估注释各种现实驾驶场景的可行性,并评估在通过基于AI的标记系统创建的像素标记上训练车辆感知系统的潜力。

-

昼夜行人序列数据集

共享数据集由两组序列组成。 这些序列被命名为白天和夜晚集,指的是它们被获取的一天中的时刻,Visible和 FIR 取决于用户记录序列的相机。 白天训练 3695 个 imegas,晚上训练 3390 个图像,每个序列大约有 1500 个强制性行人注释。 用于测试两个序列的约 700 张图像,白天约有 2000 名行人,夜间约有 1500 名行人。

-

新闻联播文字版CCTV

新闻联播文字版CCTVCCTV新闻联播文字版

¥ 200.00 起CCTV新闻联播文字版包含CCTV中央电视台2007年-2022年最新的每日播放内容文字版,内容丰富多样,包含国际国内经济、政治、文化、体育等等多个方面的信息,被称为“中国政坛的风向标”, 具有极高的研究挖掘价值。

-

Lytro Illum

共享数据集介绍: 收集了 640 个在大小、纹理、背景杂波和照明等方面具有显着变化的光场。生成微透镜图像阵列和中心观察图像,并生成相应的地面实况图。 Citation If you find our paper and repo useful, please cite our paper. Thanks! @article{Zhang2020, title={Light Field Sa

-

DUTLF-MV

共享数据集介绍 DUTLF-MV 是 DUTLF 的一部分,由 1580 个真实场景组成。该数据集的每个场景都由全焦点图像、多视图图像和相应的地面实况组成。 Accepted paper in IJCAI2019, 'Deep Light-Field-Driven Saliency Detection from A Single View', Yongri Piao, Zhengkun Rong, Light field data