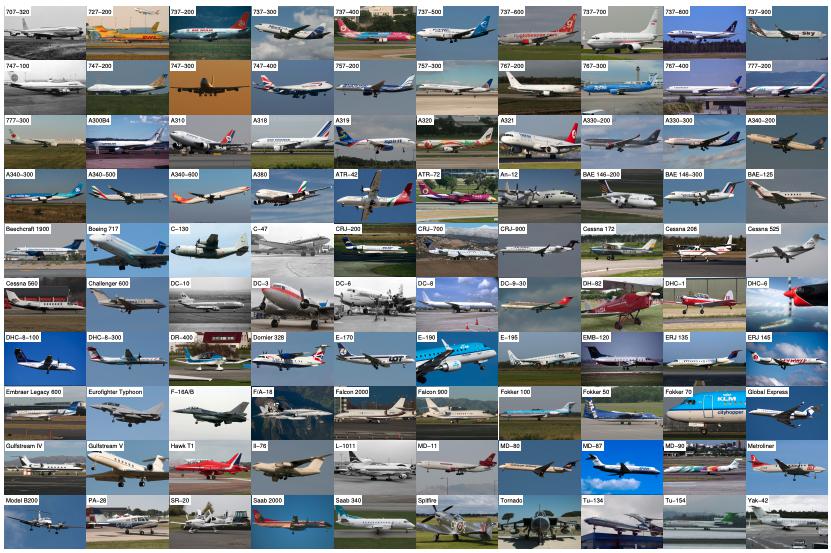

飞机数据集

数据集包含 10,000 张飞机图像,数据分为 3334 个训练图像、3333 个验证图像和 3333 个测试图像。 飞机模型按四级层次结构组织。 四个层次,从细到粗,分别是: 型号,例如 波音 737-76J。 由于某些模型在视觉上几乎无法区分,因此在评估中不使用此级别。变体,例如 波音 737-700。 一个变体将所有在视觉上无法区分的模型折叠成一个类。 该数据集包含 100 个不同的变体。家

-

飞机数据集简介

数据集包含 10,000 张飞机图像,数据分为 3334 个训练图像、3333 个验证图像和 3333 个测试图像。 飞机模型按四级层次结构组织。 四个层次,从细到粗,分别是:

型号,例如 波音 737-76J。 由于某些模型在视觉上几乎无法区分,因此在评估中不使用此级别。

变体,例如 波音 737-700。 一个变体将所有在视觉上无法区分的模型折叠成一个类。 该数据集包含 100 个不同的变体。

家庭,例如 波音 737。该数据集包含 70 个不同的家族。

制造商,例如 波音。 该数据集包含 41 个不同的制造商。

使用此数据集时,请包含以下引用:

Fine-Grained Visual Classification of Aircraft, S. Maji, J. Kannala, E. Rahtu, M. Blaschko, A. Vedaldi, arXiv.org, 2013

编辑:CVer小助手 时间:2020-07-15 RarePlanes: Synthetic Data Takes Flight作者团队:In-Q-Tel(美国中情局投资)&AI.Reverie 跨越112个地点,真实数据集是有14,700架飞机,合成数据集是有630,000架飞机,…

集开放数据、开源算法、免费算力三位一体,为开发者提供高效学习和开发环境、高价值高奖金竞赛项目,支撑高校老师轻松实现AI教学,并助力开发者学习交流,加速落地AI业务场景

数据的图像来源于谷歌地球,图像的类别为美俄现役飞机。 注:数据集仅用于学习和研究,不可用于军事用途。 数据集类别:1、helicopter直升机,包括美俄现役的直升机(V22除外)。样例图像如下 2、c130洛克希德-马…

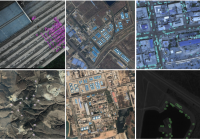

常规目标检测数据集有很多,现在前沿的目标检测算法(如Faster R-CNN, Yolo, SSD, Mask R-CNN等)基本都是在这些常规数据集上实验的,但是,基于常规数据集训练的分类器,在航空遥感图像上的检测效果并不好,主要原因是航空遥感图像有其特殊性:1,尺度多样性,航空遥感图像从几百米到近万米的拍摄高度都有,且地面目标即使是同类目标也大小不一,如港口的轮船大的有300多米,小的也只...

本数据集为飞机卫星图,包括军用、民用、以及通用飞机。图片数量1000张,图片尺寸为1024x1024,RGB彩图。仅包含一类目标:飞机。数据集已经打好标签,标签格式为常用的pascal voc格式(xml)。可以直接用于目标检测模型的训练(YOLO系列)。本数据集仅限于算法研究目的,目前为第二批,后续将发布更多的数据集。数据集下载地址:飞机数据集-02...

国内飞机航班数据库下载(Access),完整飞机航班数据库下载,定期更新以确保数据保持在最新状态,您可以在这里获取最新各种您所需的数据库。

-

小目标检测数据集

共享从Internet(例如YouTube或Google)上的图像/视频收集的四个小物体数据集,包括4种类型的图像,可用于小物体目标检测的研究。数据集包含四类:fly:飞行数据集,包含600个视频帧,平均每帧86±39个物体(648×72 @ 30 fps)。 32张图像用于训练(1:6:187),50张图像用于测试(301:6:600)。honeybee:蜜蜂数据集,包含118张图像,每张图像平均有

-

交通摄像头检测数据集

共享该数据集是来自伊利诺伊州芝加哥市交通摄像头的增强随机屏幕截图的集合。在数据中,所有车辆都被标记在一个名为 的类别中car。标签由边界框组成,并以 YOLOv5 PyTorch 格式存储。 Acknowledgements Snyder, Corey; Do, Minh (2019): Data for STREETS: A Novel Camera Network Dataset for Tr

-

雨情湖北降雨量水文长江

雨情湖北降雨量水文长江湖北省主要雨量站雨情数据

¥ 50.00 起湖北省主要雨量站雨情数据,2000年至2022年最新 湖北省雨情数据,总共6000+(月均为4000左右站点)监测站点,包含行政区编码名称,站点编码名称,时间,时段降水量mm,时段长,降水历时,日降水量mm,天气等信息,数据总量2.6亿条,11G。

-

AI-TOD航空图像数据集

共享DescriptionAI-TOD 在 28,036 张航拍图像中包含 8 个类别的 700,621 个对象实例。 与现有航拍图像中的目标检测数据集相比,AI-TOD 中目标的平均大小约为 12.8 像素,远小于其他数据集。CitationIf you use this dataset in your research, please cite these papers.@inproceeding