RGB-D行人数据集

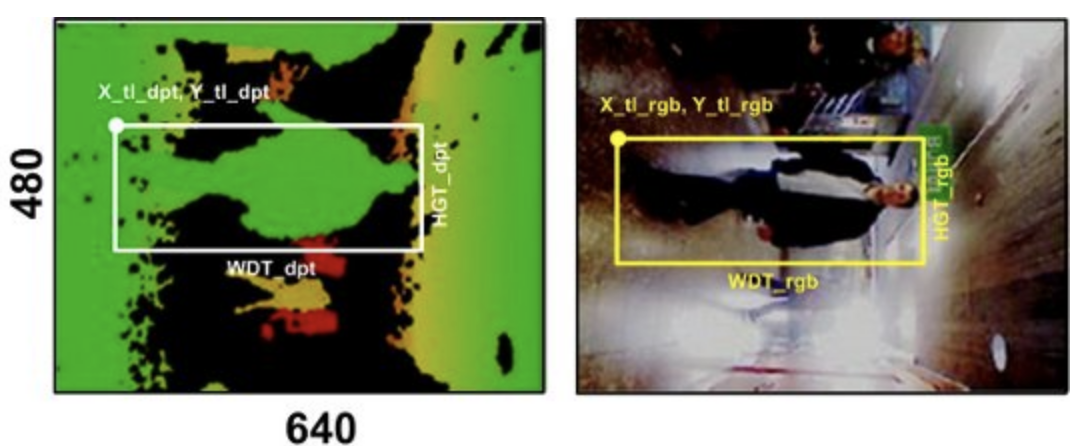

数据集介绍 该数据集包含在大学礼堂中从三个垂直安装的 Kinect 传感器获取的 3000 多个 RGB-D 帧。数据主要包含从不同方向和不同遮挡程度看到的直立行走和站立的人。 Annotation Format: Each annotated track is defined in a file named as TRACK000N.DAT . The file describes the

-

RGB-D行人数据集简介

数据集介绍

该数据集包含在大学礼堂中从三个垂直安装的 Kinect 传感器获取的 3000 多个 RGB-D 帧。数据主要包含从不同方向和不同遮挡程度看到的直立行走和站立的人。

Annotation Format:

Each annotated track is defined in a file named as TRACK000N.DAT . The file describes the position of the target in each depth frame it appears. The target visibility status is also annotated. The track-ID is encoded in the file name (TRACK000N.DAT -> track-ID N). The content of a track file is as following:

IMAGENAMEID TS Xtldpt Ytldpt WDTdpt HGTdpt Xtlrgb Ytlrgb WDTrgb HGTrgb VSB

…

where:

IMAGENAMEID = image filename, seq000012.pgm [ID: camera id, 0 = left, 1 = center, 2 = right]

TS = timestamp

Xtldpt, Ytldpt = topleft coord. bounding box in the depth image

WDTdpt, HGTdpt = size of the bounding box in the depth image

Xtlrgb, Ytlrgb = topleft coord. bounding box in the RGB image

WDTrgb, HGTrgb = size of the bounding box in the RGB image

VSB = visibility in the depth image [0 = hidden 1 = fully visible, 2 = partially visible ]

TS = timestamp

Acknowledgements

If you are considering using this data, please reference the following:

[1] L. Spinello, K. O. Arras. People Detection in RGB-D Data. IEEE Int. Conf. on Intelligent Robots and Systems (IROS), 2011.

https://ieeexplore.ieee.org/document/6095074

[2] M. Luber and L. Spinello and K. O. Arras People Tracking in RGB-D Data With On-line Boosted Target Models. IEEE Int. Conf. on Intelligent Robots and Systems (IROS), 2011.

https://www.researchgate.net/publication/221066268PeopletrackinginRGB-DDatawithon-lineboostedtargetmodels

原文链接: This is an incomplete list of datasets which were captured using a Kinect or similar devices. I initially began it to keep track...

RGBD 数据集简介,2019.12.15NYU Depth Dataset V2(3D分割任务)(C:UserslenovoAppDataRoamingTypora ypora-user-imageso6410939443.png)]

深度图像 = 普通RGB三通道彩色图像 + Depth Map RGB图和深度图是配准的,像素之间一一对应 Depth Map|深度图包含与视点场景对象表面距离有关信息的图像通道,通道本身类似于灰度图像,每个像素值是传感器测出距离…

这是一个很有名的RGB-D数据集,这个数据集是TUM的Computer Vision Lab公布的。之前大家看到一些博客上使用这个数据集,但是主要是针对纹理丰富的办公室场景,除此之外,这个数据集还有包含很多其他的场景。 数据集…

移动机器人编程一般用mrpt,这个软件来做三维,里面封装了很多常用算法。 SLAM的数据集,其中包括机器人slamhttp://vis

深度学习开源数据集 Images Analysis 图像分析 数据集介绍备注网址 Flickr30k 图片描述 31,783 images,每张图片5个语句标注 传送门 Microsoft COCO

数据集简介Market-1501数据集在清华大学校园中采集,夏天拍摄,在2015年构建并公开。它包括由6个摄像头(其中5个高清摄像头和1个低清摄像头)拍摄到的1501个行人、32668个检测到的行人矩形框。每个行人至少由2个摄像头捕获到,并且在一个摄像头中可能具有多张图像。训练集有751人,包含12,936张图像,平均每个人有17.2张训练数据;测试集有750人

Get the latest weather forecast in Shuangliu, Sichuan, China for today, tomorrow, long range weather and the next 14 days, with accurate temperature, feels like and humidity levels.

ScanNet数据集

1513个采集场景数据,21个类别的对象,其中,1201个场景用于训练,312个场景用于测试。

该数据集有四个评测任务:3D语义分割、3D实例分割、2D语义分割和2D实例分割。SUN RGB-D 数据集

该数据集有四个评测任务:场景分类,语义分割,室内布局估计,3D目标检测。包含10,335个 RGB-D 图像,其规模与 PASCAL VOC 相似;

是NYU depth v2 , Berkeley B3DO , and SUN3D ,三个数据集的并集;

整个数据集都进行了密集注释,其中包括 146,617 个 2D 多边形(平面目标框)和64,595个具有精确物体方向的3D 边界框(三维目标框);

具有较高的物体方向的准确性及 3D 空间布局和场景分类。

-

DUTLF-V2

共享数据集介绍: 由于具有强大的三维信息捕捉能力,光场数据为显著性检测算法提供了更为有力的支持。但算法的能力取决于数据集构建的全面性、有效性、规模化和多样性,同时也取决于灵活高效的模型设计。为了促进这一领域的发展,来自大连理工的研究人员构建了大规模的多功能数据集,其中包含了102类目标、共4202个样本,可以有效支持基于RGB、RGB-D和光场数据的显著性检测算法。

-

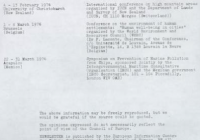

文档影印和内容数据

共享MediaTeam Oulu Document 数据集是一个文档扫描图像和文档内容数据集,包含 500篇 1975年之前的文档信息。

-

宠物图像数据集

共享一个包含 37 个类别的宠物数据集,每个类别大约有 200 张图像。 这些图像在比例、姿势和照明方面有很大的变化。 所有图像都有相关的品种、头部 ROI 和像素级三元图分割的地面实况注释。Dataset StatisticsRelevant PublicationsO. M. Parkhi, A. Vedaldi, A. Zisserman, C. V. JawaharCats and DogsI

-

FMD(荧光显微镜去噪)数据集

共享荧光显微镜使现代生物学取得了巨大的发展。由于其固有的微弱信号,荧光显微镜不仅比摄影噪声大得多,而且还呈现出泊松-高斯噪声,其中泊松噪声或散粒噪声是主要的噪声源。为了获得干净的荧光显微镜图像,非常需要有专门设计用于对荧光显微镜图像进行降噪的有效降噪算法和数据集。虽然存在这样的算法,但没有这样的数据集可用。在本文中,我们通过构建专用于泊松-高斯去噪的数据集 - 荧光显微镜去噪 (FMD) 数据集来填补